Apprentissage automatique sécurisé, sûr et équitable pour les applications en santé

Responsable(s) coordinateur(s) du projet : Jamal Atif et Aurélien Bellet

Établissement coordinateur : Université Paris Sciences & Lettres (PSL)

Apprentissage automatique, données de santé massives, confiance, cybersécurité, apprentissage fédéré, confidentialité, robustesse, équité

Le secteur de la santé (public et privé) génère une grande quantité de données provenant de sources aussi diverses que les dossiers médicaux électroniques, les techniques d’imagerie avancées, le séquençage à haut débit, les dispositifs portables et les données de santé publique. L’exploitation de ces données par des algorithmes sophistiqués d’apprentissage automatique a le potentiel de transformer la pratique du soin en permettant le développement de traitements, d’interventions et de politiques publiques plus efficaces et davantage personnalisés, et d’améliorer la prestation des soins de santé et au bout du compte le bien-être de la population. Toutefois, le caractère hautement sensible des données de santé, les risques de cybersécurité, les biais dans les données et le manque de robustesse des algorithmes d’apprentissage automatique constituent autant de facteurs qui empêchent actuellement de tirer pleinement bénéfice des avancées récentes en intelligence artificielle.

Pour s’affranchir de cet état de fait, il est essentiel de surmonter les défis éthiques et juridiques, de sécurité et de robustesse. Ce projet vise à développer de nouveaux algorithmes d’apprentissage automatique qui prennent en compte les caractéristiques multi-échelles et hétérogènes des données de santé, tout en garantissant la confidentialité, la robustesse contre les attaques adverses et les changements de dynamiques des données et modèles, et l’équité pour les populations sous-représentées.

En s’attaquant à ces obstacles, l’équipe du projet espère libérer les verrous qui freinent le déploiement de solutions innovantes en santé numérique. Plus précisément, SSF-ML-DH se concentrera sur les défis suivants :

- l’apprentissage respectueux de la vie privée en s’appuyant sur les techniques de confidentialité différentielle et de chiffrement homomorphe ;

- l’apprentissage fédéré en établissant des compromis entre précision et confidentialité ;

- la robustesse aux attaques adverses et changements de dynamiques des données et des modèles ;

- le « désapprentissage » automatique pour implémenter le droit à l’oubli.

Le projet réunit un consortium inédit composé de spécialistes de l’apprentissage automatique, de la cybersécurité, des statistiques, et des applications médicales. En outre, il est positionné entre deux PEPR (Cybersécurité et Santé Numérique), ce qui lui confère un caractère particulier de diffusion des connaissances et des pratiques entre des communautés de recherche qui n’avaient jusqu’à présent que peu de place pour interagir.

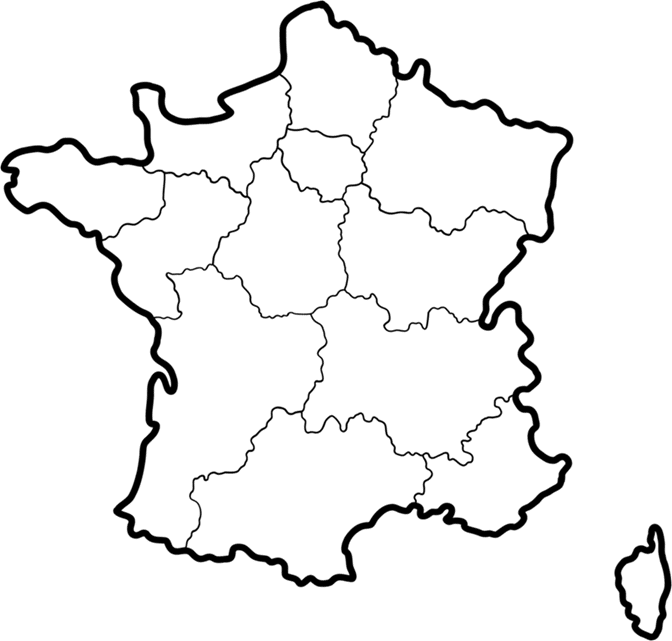

| Unité | Tutelles |

| LAMSADE – UMR7243 | CNRS, Université Paris-Dauphine-Paris Sciences & Lettres (PSL), |

| LaTIM – U 1101 – Eq Cyber Health | Inserm, Université de Bretagne Occidentale, IMT Atlantique

CHU Brest partenaire |

| CRIStAL UMR 9189 – Eq Inria Magnet | CNRS, Inria, Université de Lille, Central Lille institut,

Mines Télécom partenaire |

| Inria Centre at Université Côte d’Azur, Eq Inria PREMEDICAL | Inria, INSERM, Université de Montpellier |

| CEA LIST – Dpt DIN et DSCIN | CEA, Université Paris-Saclay |

| DI-ENS – UMR 8548 | CNRS, ENS, PSL, Inria |

| Inria Sophia Antipolis, Eq EPIONE | Inria, Université Côte d’Azur |

| CITI Lab – Eq Inria Privatics | INSA, Inria Grenoble, Inria Lyon, Université de Lyon |